Azure VM serie 6 e Azure Boost: meno overhead, più prestazioni

Negli ultimi mesi ho utilizzato parecchio le nuove VM serie 6 di Microsoft Azure nei miei corsi e nei lab, e devo dire che le ho trovate molto performanti. La sensazione, fin dai primi utilizzi, è quella di avere tra le mani macchine più reattive, che reggono meglio carichi anche contemporanei senza “sedersi”.

Parliamo di scenari concreti: più macchine accese, deployment continui, test, magari qualche script di automazione. Situazioni normali per chi fa formazione o lavora su ambienti dinamici. Ecco, in questi contesti la differenza si nota.

Non è solo una questione di CPU o RAM. Dietro c’è anche Azure Boost, una tecnologia meno visibile ma che incide in modo diretto su prestazioni, latenza e gestione dell’I/O.

VM serie 6: cosa cambia davvero

Con le nuove VM serie 6 di Microsoft Azure non avete semplicemente più risorse, ma un comportamento più stabile e reattivo. Nei laboratori si nota subito: anche con più attività in parallelo, le macchine restano fluide e senza quei rallentamenti improvvisi tipici delle serie precedenti.

La differenza non è solo nella potenza, ma in come viene gestita. Qui entra in gioco Azure Boost, che sposta parte del lavoro (soprattutto rete e storage) fuori dalla CPU, affidandolo a hardware dedicato. Il risultato è una CPU più libera e prestazioni più costanti.

Nella pratica, questo si traduce in meno latenza, meno colli di bottiglia e un’esperienza più lineare, soprattutto nei contesti dinamici come lab e corsi. Non è solo “più veloce”, è decisamente più efficiente.

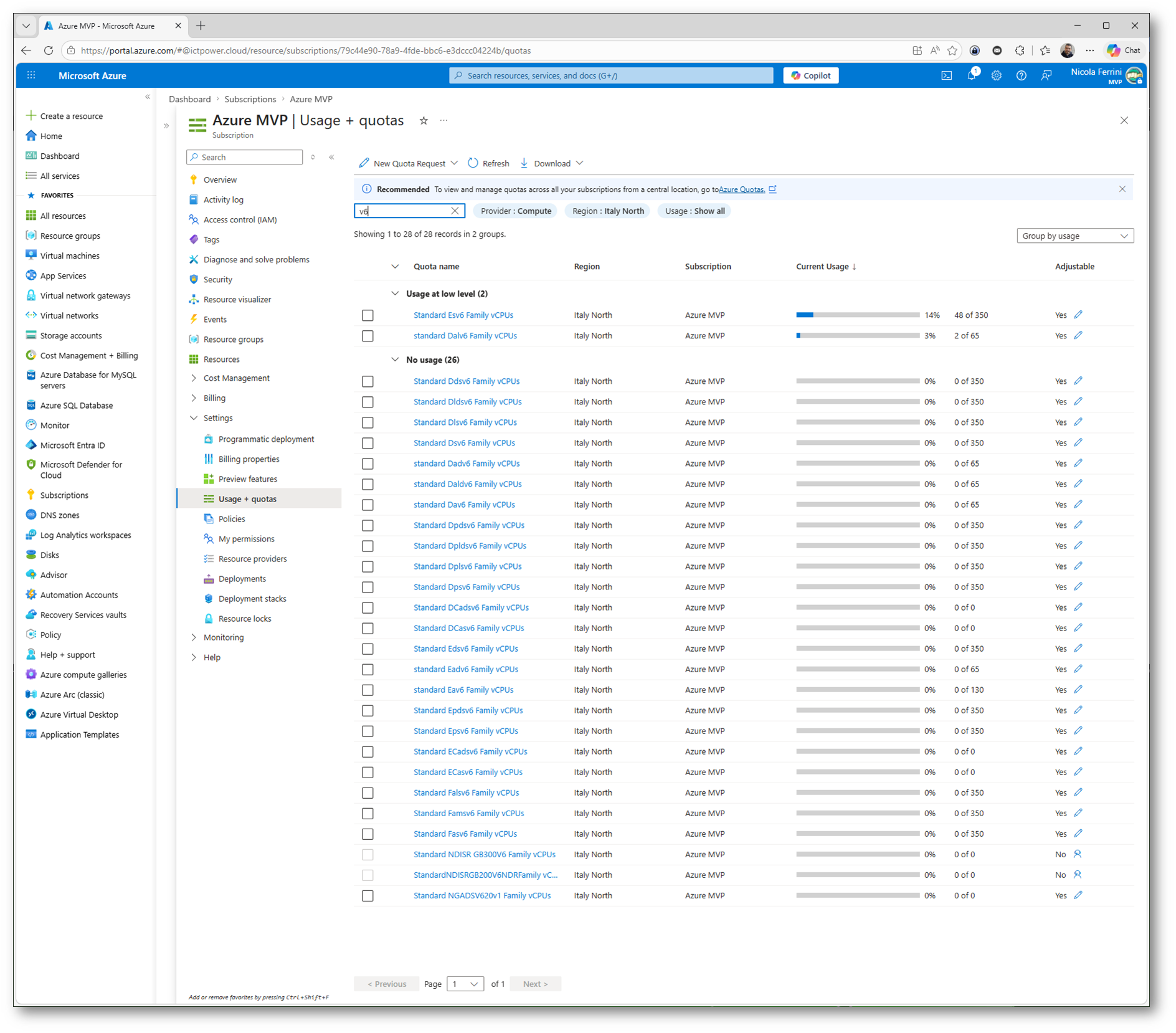

Figura 1: Quote VM serie 6 in Azure: panoramica delle famiglie disponibili in Italy North

Azure Boost: cosa c’è dietro

A questo punto vale la pena capire meglio cosa fa davvero Azure Boost. Non è una feature che attivate, ma un cambiamento nell’infrastruttura di Microsoft Azure che incide direttamente su come girano le vostre VM e che introduce un modello più efficiente di gestione delle operazioni critiche delle macchine virtuali.

A differenza di soluzioni come Azure Accelerated Networking, che si concentrano principalmente sulla rete, Azure Boost agisce in modo più esteso. Non si limita ad accelerare il traffico, ma interviene anche su storage e virtualizzazione, rendendo l’intero sistema più leggero dal punto di vista della CPU.

Rispetto alle SmartNIC tradizionali, il salto è proprio qui: non si tratta solo di delegare alcune funzioni di rete, ma di spostare una parte significativa del lavoro infrastrutturale su hardware dedicato, progettato specificamente per questo scopo.

Alla base c’è il concetto di offloading hardware, dove componenti come ASIC (che puntano alla massima performance) o FPGA (che offrono più adattabilità) gestiscono operazioni che prima gravavano sulla CPU della VM. Il risultato è una riduzione dell’overhead e un utilizzo più efficiente delle risorse.

ASIC e FPGA: cosa significano

Quando si parla di Azure Boost, si citano spesso ASIC e FPGA. Sono entrambe tipologie di hardware specializzato, ma con caratteristiche diverse.

Un ASIC (Application-Specific Integrated Circuit) è un chip progettato per svolgere una funzione specifica. È estremamente veloce ed efficiente, ma non è flessibile: una volta costruito, fa solo quello per cui è stato progettato. È ideale quando avete operazioni ben definite da accelerare, come networking o crittografia.

Un FPGA (Field-Programmable Gate Array), invece, è un chip programmabile. Può essere riconfigurato anche dopo la produzione per svolgere funzioni diverse. Questo lo rende molto più flessibile, anche se generalmente meno ottimizzato di un ASIC puro.

Azure utilizza questi componenti per gestire operazioni come rete e storage direttamente a livello hardware. In questo modo si riduce il carico sulla CPU e si ottengono prestazioni più efficienti e costanti.

Come funziona Azure Boost nella pratica

Nel concreto, Azure Boost sposta fuori dalla macchina virtuale una serie di attività che normalmente incidono sulle prestazioni. Parliamo di operazioni legate alla rete, all’accesso ai dischi e a parte della virtualizzazione stessa.

Questo cambiamento riduce il cosiddetto overhead, cioè il lavoro “invisibile” che la CPU deve svolgere per gestire l’infrastruttura. Di conseguenza, avete più risorse disponibili per il vostro workload reale.

Un altro aspetto importante è il data path più diretto. I dati seguono un percorso più ottimizzato tra VM, rete e storage, con meno passaggi intermedi. Questo si traduce in una latenza più bassa e in prestazioni più costanti.

Potremmo dire che Azure Boost non rende solo le VM più veloci, ma le rende soprattutto più efficienti.

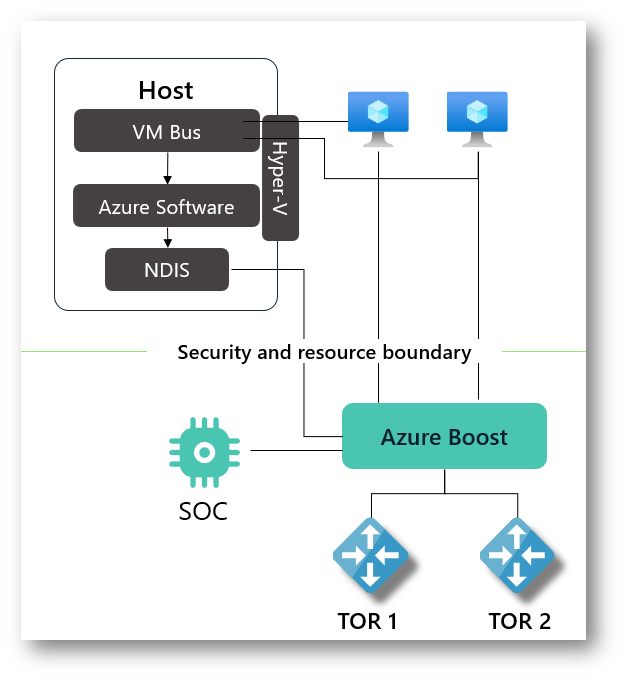

L’immagine sotto mostra chiaramente dove si inserisce Azure Boost nell’architettura di Microsoft Azure.

Nella parte superiore vedete il modello tradizionale: le operazioni passano attraverso Hyper-V, lo stack software Azure e componenti come NDIS per la rete. Tutto questo introduce overhead e utilizzo della CPU dell’host.

Con Azure Boost, invece, una parte di queste operazioni viene spostata sotto il livello della security boundary, su hardware dedicato. Qui interviene il blocco “Azure Boost”, che gestisce direttamente il traffico verso la rete (TOR switch) e parte delle operazioni di I/O.

Il risultato è un data path più diretto, con meno passaggi software. La CPU dell’host viene alleggerita e le macchine virtuali ottengono prestazioni più costanti e con latenza più bassa.

Figura 2: Azure Boost nell’architettura Azure – offloading delle operazioni fuori dall’host e percorso dati ottimizzato

Azure Boost e storage

Uno degli aspetti più interessanti di Azure Boost è come cambia la gestione dello storage in Microsoft Azure.

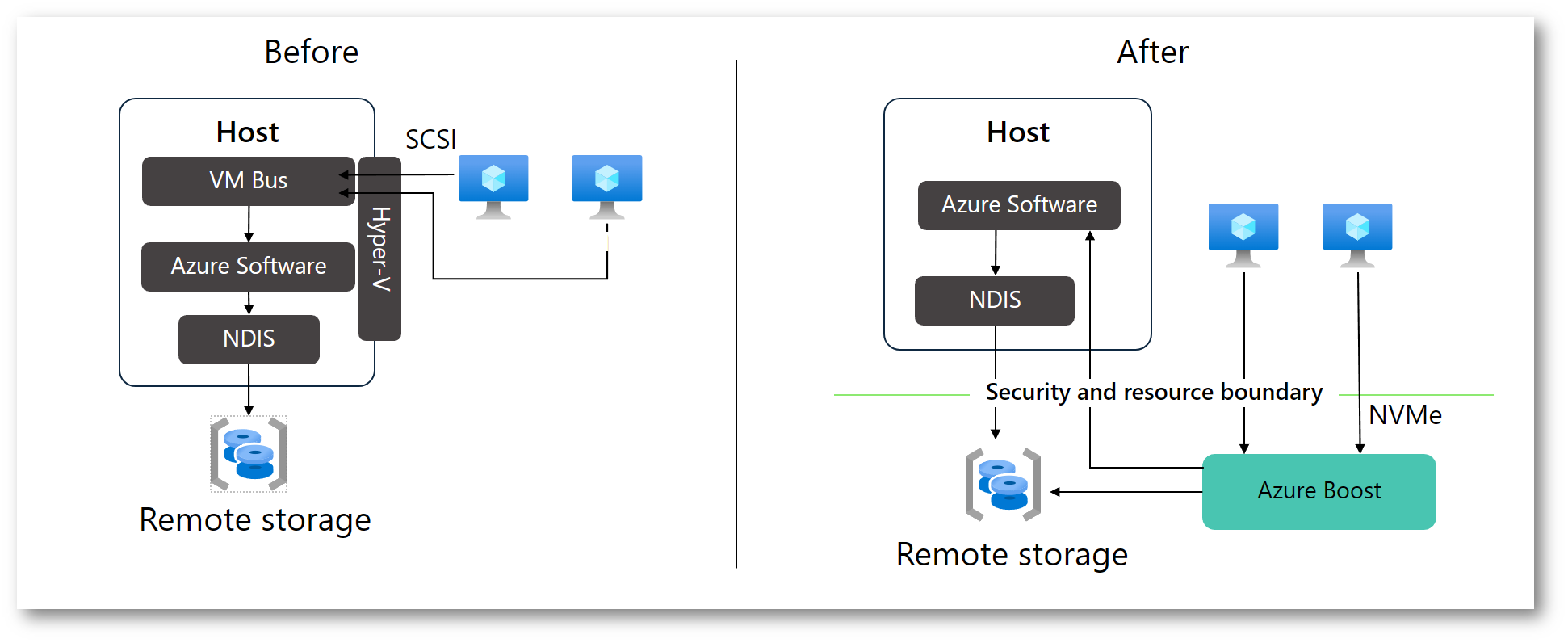

L’architettura introduce un vero offloading dell’I/O disco, che copre sia dischi locali che remoti e cache. Questo significa che le operazioni di storage non passano più interamente dalla CPU dell’host, ma vengono gestite da hardware dedicato. Il risultato è una riduzione dell’overhead, minore instabilità e una latenza più bassa.

Di fatto Azure Boost è già utilizzato per accelerare workload reali, inclusi scenari più esigenti come alcune VM ottimizzate per storage. Il beneficio non è solo prestazionale, ma anche economico, perché in alcuni casi permette di ottenere gli stessi risultati con macchine più piccole.

Dal punto di vista delle prestazioni, i numeri sono importanti: si arriva fino a 14 GBps e circa 750.000 IOPS su storage remoto. Questo è possibile grazie all’introduzione di interfacce NVMe, che sostituiscono i modelli più tradizionali e rendono il percorso dei dati molto più diretto.

Figura 3: Azure Boost e storage – confronto tra architettura tradizionale (SCSI) e nuovo modello NVMe con offloading hardware

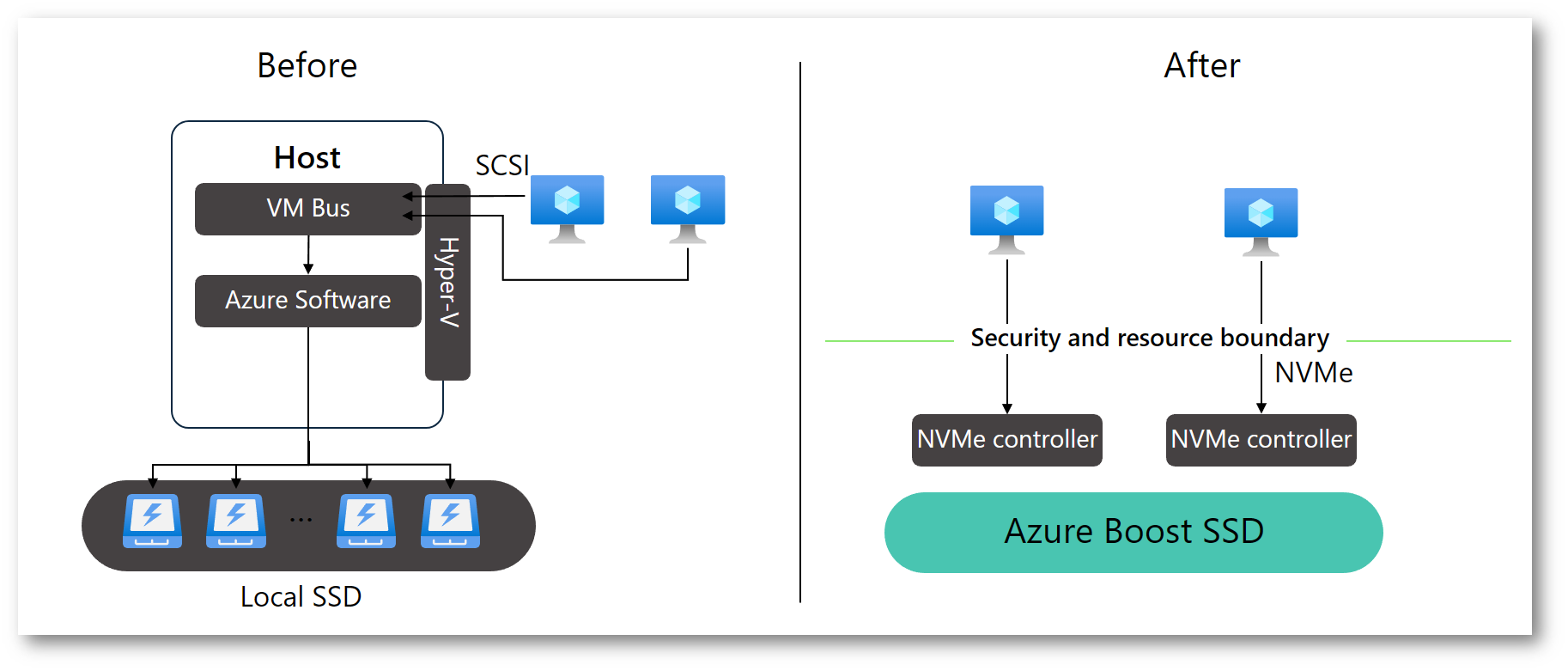

Sul lato dischi locali, il salto è ancora più evidente.

Con le unità SSD Azure Boost, si raggiungono valori fino a 36 GBps e 6,6 milioni di IOPS, a seconda della dimensione della VM. Anche qui il cambiamento principale è il passaggio a dischi NVMe, progettati per offrire prestazioni elevate con una latenza molto ridotta.

Un altro aspetto importante è la gestione della crittografia, che viene ottimizzata per non introdurre penalizzazioni significative sulle prestazioni.

Come si può vedere dalla figura sotto, nel modello “Before”, anche i dischi locali passano attraverso lo stack dell’host e Hyper-V, utilizzando interfacce SCSI. Questo comporta più livelli software e quindi maggiore latenza e utilizzo della CPU.

Nel modello “After”, con Azure Boost SSD, le macchine virtuali accedono ai dischi locali tramite controller NVMe esposti direttamente. Il tutto avviene sotto il livello di security boundary, senza passare dallo stack di virtualizzazione tradizionale.

Figura 4: Azure Boost SSD – evoluzione dei dischi locali da SCSI a NVMe con accesso diretto e minore overhead

Casi d’uso ideali

Le VM serie 6 danno il meglio quando avete workload dove contano prestazioni costanti e bassa latenza.

Sono particolarmente adatte in ambito HPC, dove ogni millisecondo conta e la variabilità delle prestazioni può diventare un problema. Lo stesso vale per scenari AI/ML, sia in fase di training che di inference, dove la gestione efficiente di CPU, rete e storage fa la differenza.

Un altro ambito naturale è quello dei database ad alta intensità I/O perché qui Azure Boost aiuta a ridurre la latenza e a mantenere prestazioni più stabili, soprattutto sotto carico.

Best practice di configurazione

Per sfruttare davvero le VM serie 6 e i benefici di Azure Boost in Microsoft Azure, la configurazione fa ancora la differenza.

La prima cosa da verificare è l’uso di Azure Accelerated Networking. Anche se Azure Boost migliora il data path, questa opzione resta fondamentale per ottenere il massimo lato rete e ridurre ulteriormente la latenza.

Lo storage va scelto in modo coerente con il workload. Dischi Premium o Ultra permettono di mantenere prestazioni elevate e costanti, evitando che lo storage diventi il collo di bottiglia.

Un altro punto chiave è il dimensionamento. Con la serie 6 conviene evitare il sovradimensionamento “difensivo” tipico del passato e puntare su una scelta più mirata, sfruttando la maggiore efficienza dell’infrastruttura.

Ricordatevi che il monitoraggio resta essenziale. Tenere sotto controllo metriche come CPU, IOPS e latenza vi permette di capire se state sfruttando davvero il potenziale della macchina o se è necessario intervenire.

Conclusioni

Le VM serie 6 di Microsoft Azure rappresentano un’evoluzione concreta, non solo in termini di potenza ma soprattutto di efficienza.

Con Azure Boost, il cambiamento è meno visibile ma molto reale: meno overhead, latenza più bassa e prestazioni più costanti. È un approccio diverso, dove l’hardware fa una parte sempre più importante del lavoro.

Nel quotidiano, questo si traduce in ambienti più prevedibili e meglio ottimizzati. Non è sempre necessario adottarle subito, ma in molti scenari diventano una scelta naturale.

Una volta provate è facile apprezzarne i vantaggi. E difficilmente si torna indietro. 😊