Introduzione ad Azure Virtual Network Routing Appliance (Preview)

Microsoft ha annunciato da pochissimo la funzionalità Azure Virtual Network Routing Appliance, attualmente in preview. Questo significa che siamo davanti a una capability ancora in evoluzione, con possibili limitazioni, cambiamenti architetturali e vincoli operativi tipici delle funzionalità non ancora in General Availability (GA).

La documentazione ufficiale di riferimento è Virtual Network Routing Appliance Overview – Azure Virtual Network | Microsoft Learn

Con questa novità, Azure introduce un modo più strutturato per integrare una Routing Appliance all’interno di una Virtual Network (VNet), semplificando la gestione del routing rispetto agli approcci tradizionali basati esclusivamente su User Defined Routes (UDR) e su Network Virtual Appliance (NVA) distribuite manualmente nelle subnet.

L’obiettivo è chiaro: rendere più coerente e governabile l’instradamento del traffico, in particolare negli scenari:

- Hub & Spoke

- ispezione del traffico con appliance di sicurezza

- integrazione con ambienti ibridi

Essendo una funzionalità ancora in preview, è importante affrontarla con il giusto livello di consapevolezza progettuale. Come per tutte le feature non ancora in General Availability, potrebbero esserci limitazioni legate alle regioni supportate, componenti non ancora completamente maturi o funzionalità che verranno estese o modificate nel corso del tempo.

Inoltre, in questa fase non è previsto un SLA formale, e questo elemento da solo dovrebbe orientare le scelte architetturali: l’utilizzo in ambienti production-ready va valutato con estrema cautela.

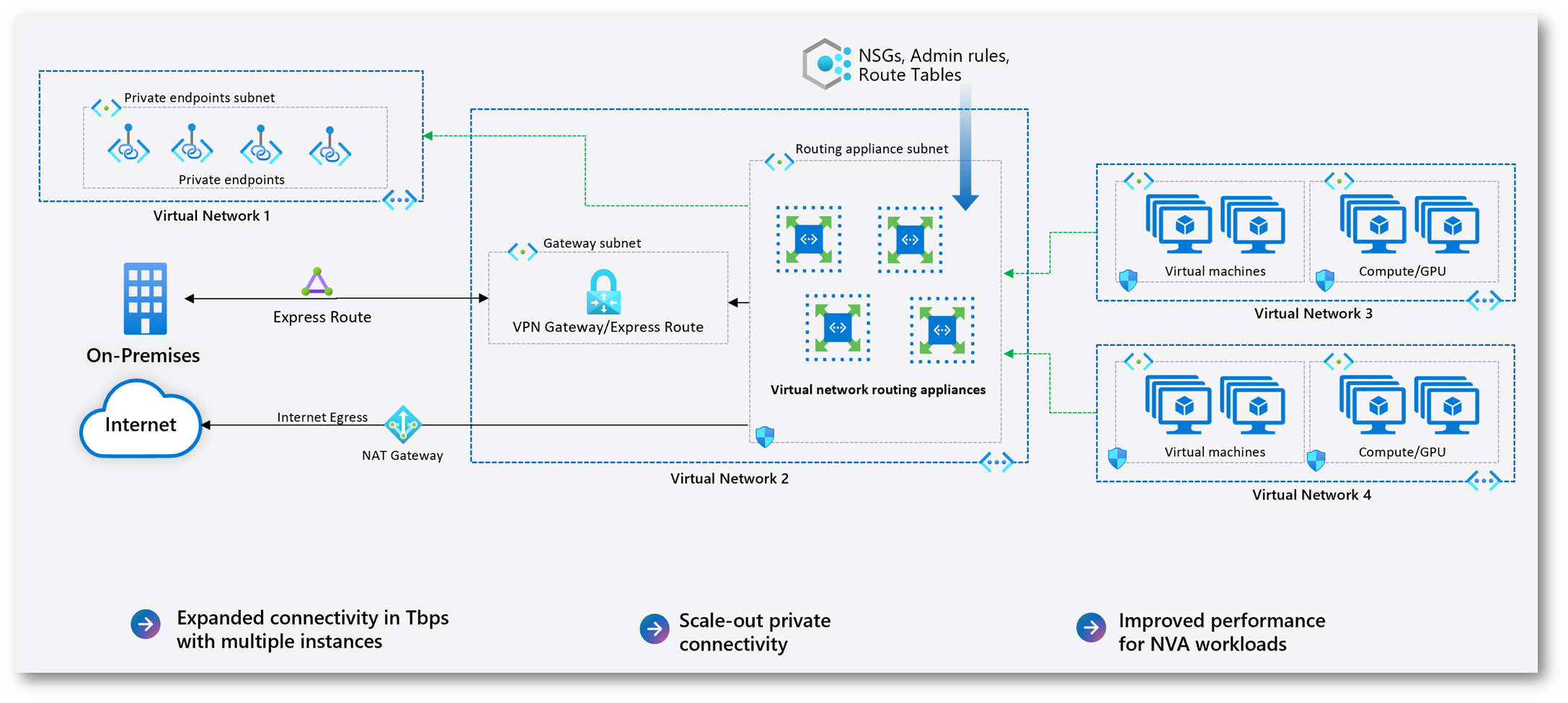

Figura 1: Utilizzo di Azure Virtual Network Routing Appliance

Uno degli aspetti più rilevanti è che la Routing Appliance è una risorsa di primo livello in Azure. Questo significa che si integra nativamente con il modello di management della piattaforma: può essere distribuita, configurata e governata tramite gli strumenti standard di Azure, mantenendo coerenza con le pratiche di governance già adottate.

Il deployment avviene all’interno di una subnet dedicata della Virtual Network, dove l’appliance svolge il ruolo di layer di forwarding ad alta banda per il traffico instradato. In altre parole, diventa il punto centrale attraverso cui transitano i flussi che richiedono routing avanzato.

Dal punto di vista architetturale, il beneficio più evidente è che non è più necessario utilizzare macchine virtuali proprie come livello di forwarding. La componente di instradamento viene gestita direttamente da Azure come servizio gestito, con vantaggi in termini di semplificazione operativa, scalabilità orizzontale e riduzione dei possibili colli di bottiglia.

Gli scenari per cui questa soluzione è particolarmente indicata includono:

- necessità di scalare orizzontalmente la capacità di routing al crescere della banda

- riduzione della latenza nei flussi east-west

- eliminazione di bottleneck nelle topologie di rete

- mantenimento di un modello di gestione completamente Azure-native

Quindi, giusto per farla breve, la Virtual Network Routing Appliance si posiziona come un dispositivo di routing gestito da Azure, distribuito direttamente all’interno della Virtual Network, che fornisce un forwarding ad alta capacità senza richiedere la gestione diretta di infrastruttura IaaS dedicata al routing.

Dal punto di vista della High Availability, la Virtual Network Routing Appliance offre un’architettura intrinsecamente resiliente, con supporto nativo alle Availability Zone. La componente è progettata per garantire ridondanza e alta banda senza la necessità di introdurre un Load Balancer davanti all’appliance. Anzi, la documentazione ufficiale Microsoft specifica chiaramente che l’inserimento di un load balancer non è richiesto e, se configurato, non inoltrerà traffico verso l’appliance. Questo aspetto semplifica il design e riduce ulteriormente la complessità architetturale.

Essendo una funzionalità in public preview, la disponibilità è limitata a un insieme ristretto di regioni Azure. Attualmente la Routing Appliance è disponibile in: East US, East US 2, West Central US, West US, North Europe, UK South, West Europe ed East Asia. Questo vincolo geografico è un elemento da considerare attentamente in fase di progettazione, soprattutto in scenari multi-region o con requisiti specifici di data residency.

Creazione di una Azure Virtual Network Routing Appliance (Preview)

Per creare una Azure Virtual Network Routing Appliance è necessario seguire la procedura descritta nella documentazione ufficiale Microsoft: Create a Virtual Network Routing Appliance – Azure Virtual Network | Microsoft Learn

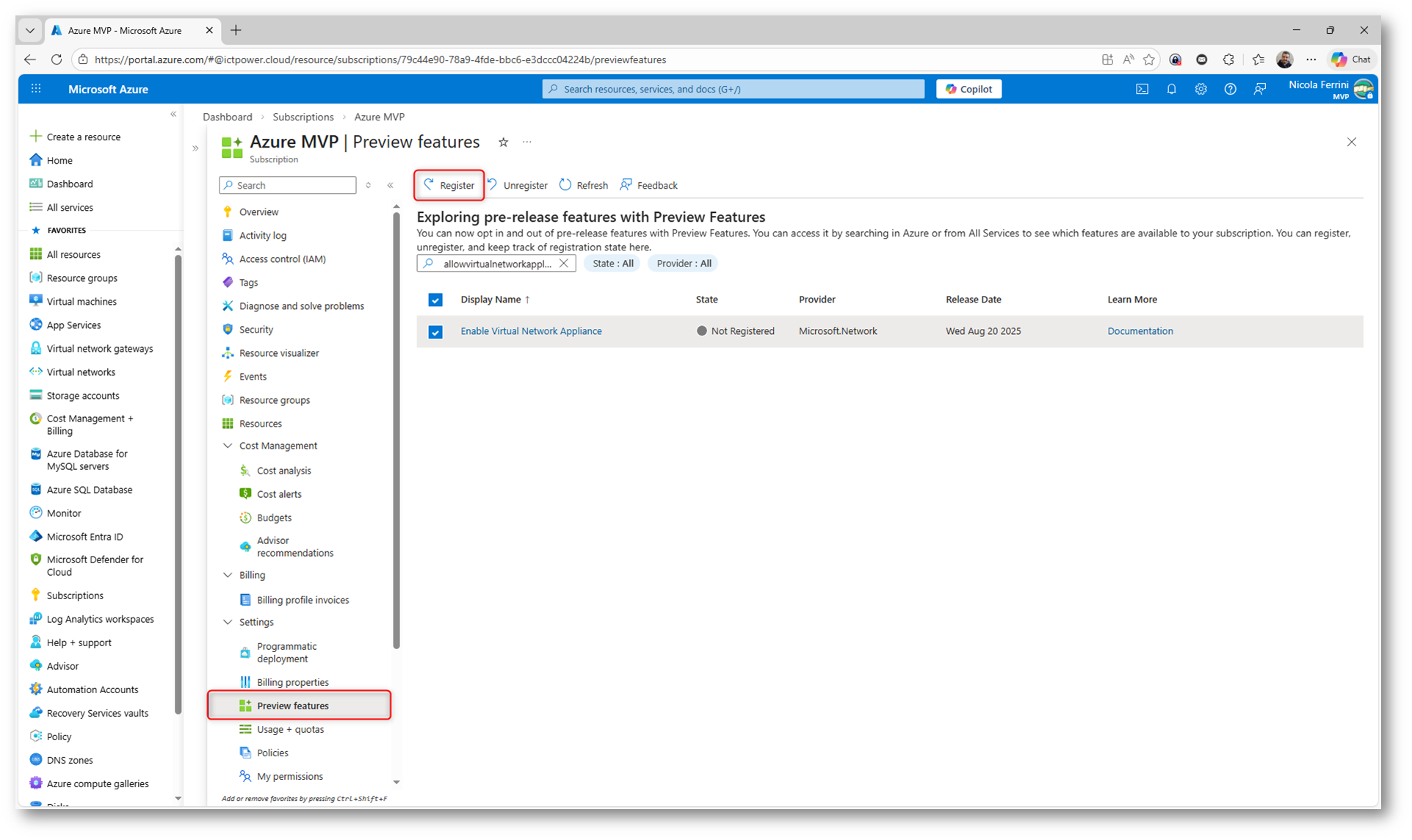

Trattandosi di una funzionalità in preview, il primo passaggio non è tecnico ma amministrativo: bisogna abilitare la feature sulla subscription. Microsoft utilizza il meccanismo di Azure Feature Exposure Control (AFEC) e, nello specifico, va registrata la feature Microsoft.Network/AllowVirtualNetworkAppliance. Fino a quando la registrazione non viene completata e approvata, il servizio non sarà visibile nel portale e non sarà possibile procedere con il deploy.

Dalla schermata della Subscription, si accede alla sezione Preview features. Qui è possibile cercare la feature specifica legata alla Virtual Network Routing Appliance. Nel caso mostrato, è presente la voce Enable Virtual Network Appliance, con stato Not Registered e provider Microsoft.Network.

Per abilitare la funzionalità è sufficiente selezionare la feature e fare clic su Register nella barra superiore. A questo punto Azure avvia il processo di registrazione della feature sulla subscription.

Figura 2: Registrazione della feature Enable Virtual Network Appliance dalla sezione Preview features della Subscription

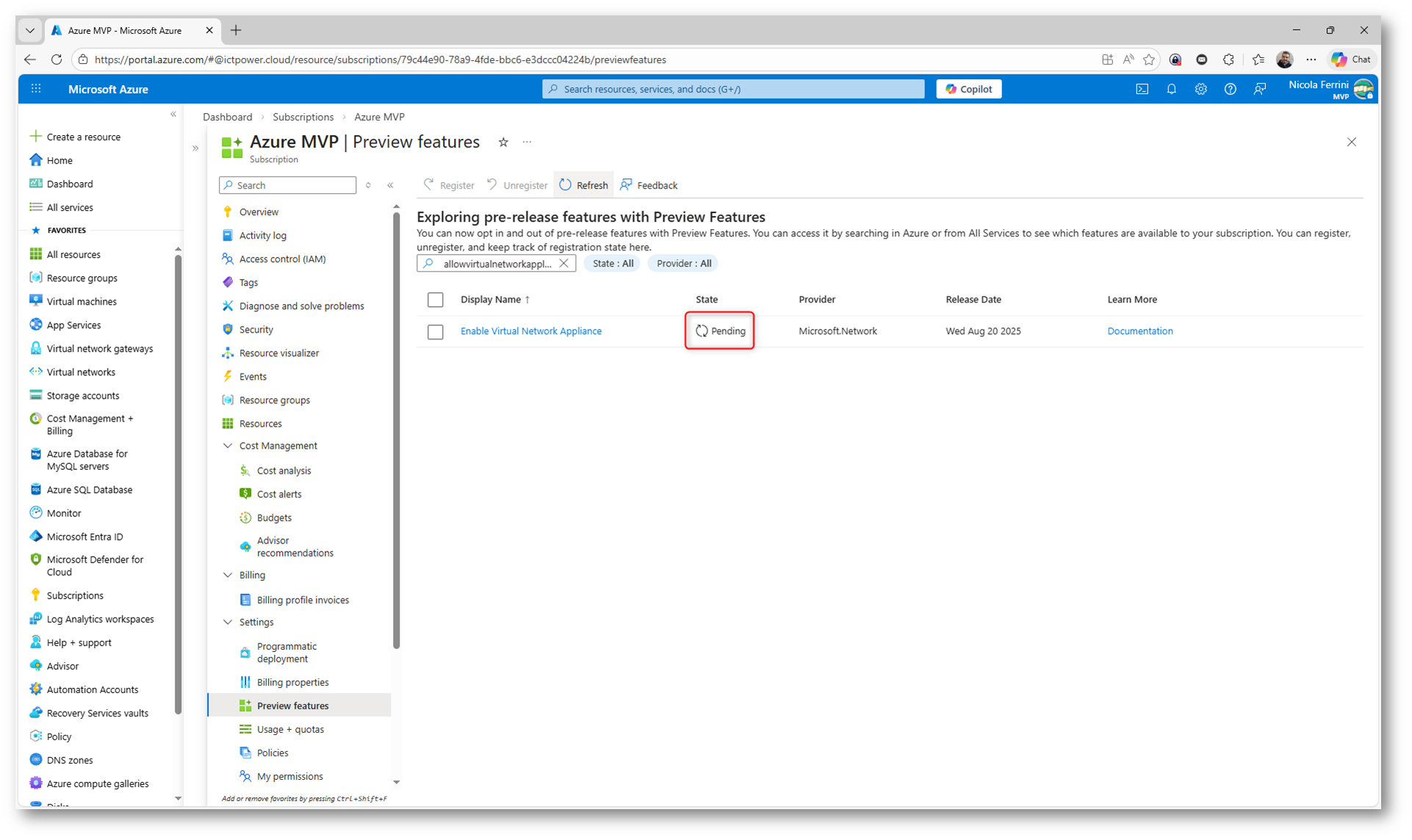

Dopo aver avviato la registrazione, lo stato della feature passa a Pending, come mostrato nella schermata. Questo significa che la richiesta è stata inoltrata, ma la funzionalità non è ancora effettivamente abilitata sulla Subscription.

Nel caso della Azure Virtual Network Routing Appliance, la sola registrazione tecnica della feature non è sufficiente. Come indicato nella documentazione ufficiale Microsoft (Create a virtual network routing appliance), è necessario compilare il form di registrazione presente nella pagina dedicata alla preview. Solo dopo l’invio e l’approvazione della richiesta da parte di Microsoft, lo stato passerà a Registered.

Figura 3: La feature Enable Virtual Network Appliance in stato Pending in attesa dell’approvazione della richiesta di accesso alla preview

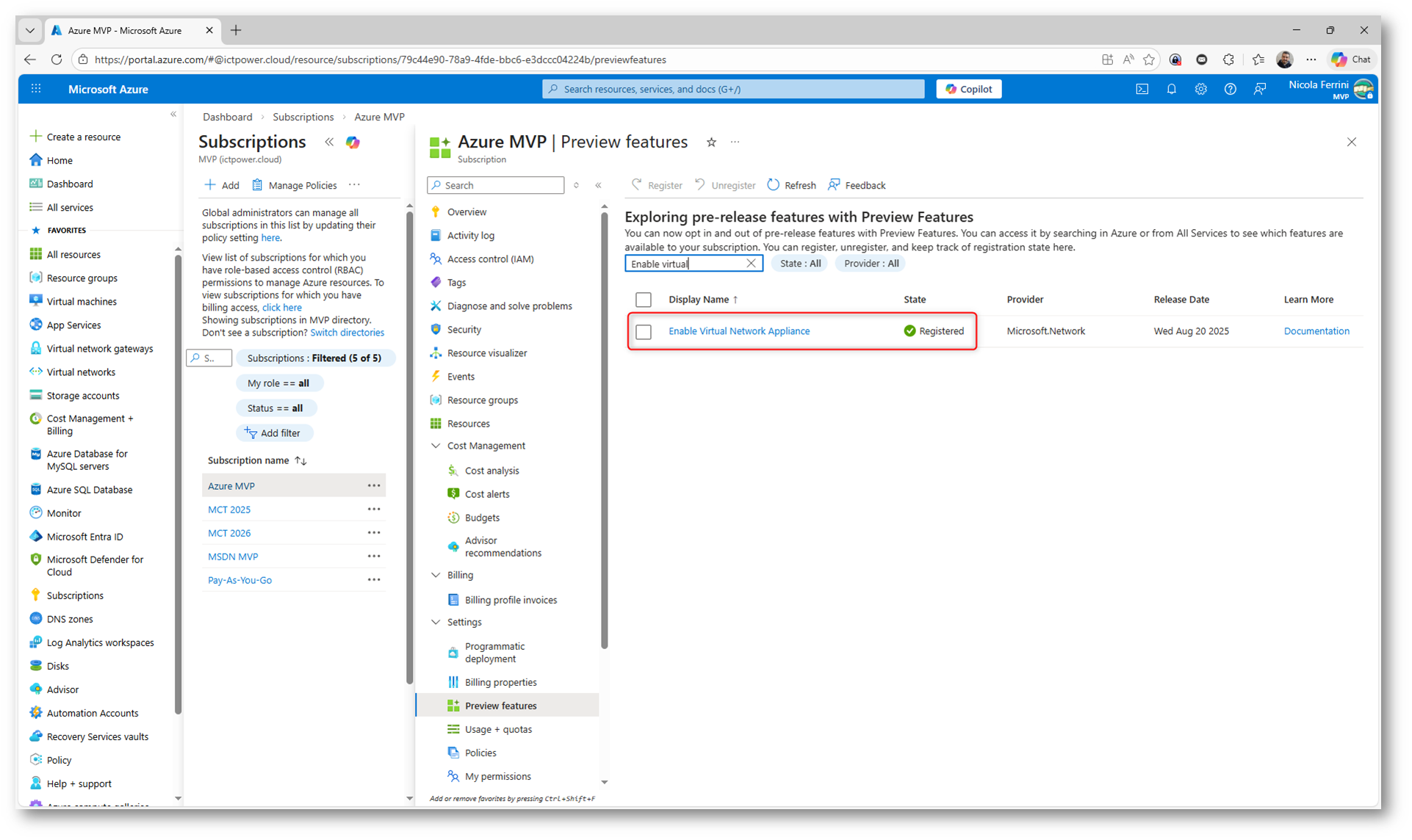

Una volta compilato l’apposito form di registrazione indicato nella documentazione ufficiale Microsoft, non resta che attendere l’attivazione della feature da parte del team Azure. Nel mio caso sono stati necessari 3 giorni.

Come si vede nella schermata, lo stato della feature passa finalmente a Registered. Solo in questo momento la Virtual Network Routing Appliance è effettivamente abilitata sulla Subscription e diventa disponibile per la creazione dal portale.

L’attivazione non è immediata: normalmente, dopo qualche giorno dalla richiesta, si riceve una mail di conferma che comunica l’abilitazione della funzionalità per la sottoscrizione indicata nel form. È solo dopo questa conferma che la feature risulta pienamente operativa.

Figura 4: La feature Enable Virtual Network Appliance risulta Registered dopo l’approvazione della richiesta di accesso alla preview

Una volta che la feature risulta Registered, possiamo verificare che la funzionalità sia effettivamente disponibile nel portale.

Dalla barra di ricerca in alto nel Portale Azure, digitate “Virtual network routing appliance”. Se la registrazione è andata a buon fine e l’abilitazione è stata completata, vedrete comparire la voce Azure Virtual Network routing appliances (PREVIEW) tra i servizi disponibili.

Figura 5: La risorsa Azure Virtual Network routing appliances (Preview) è disponibile nel portale dopo la registrazione della feature

Creazione dell’ambiente di test

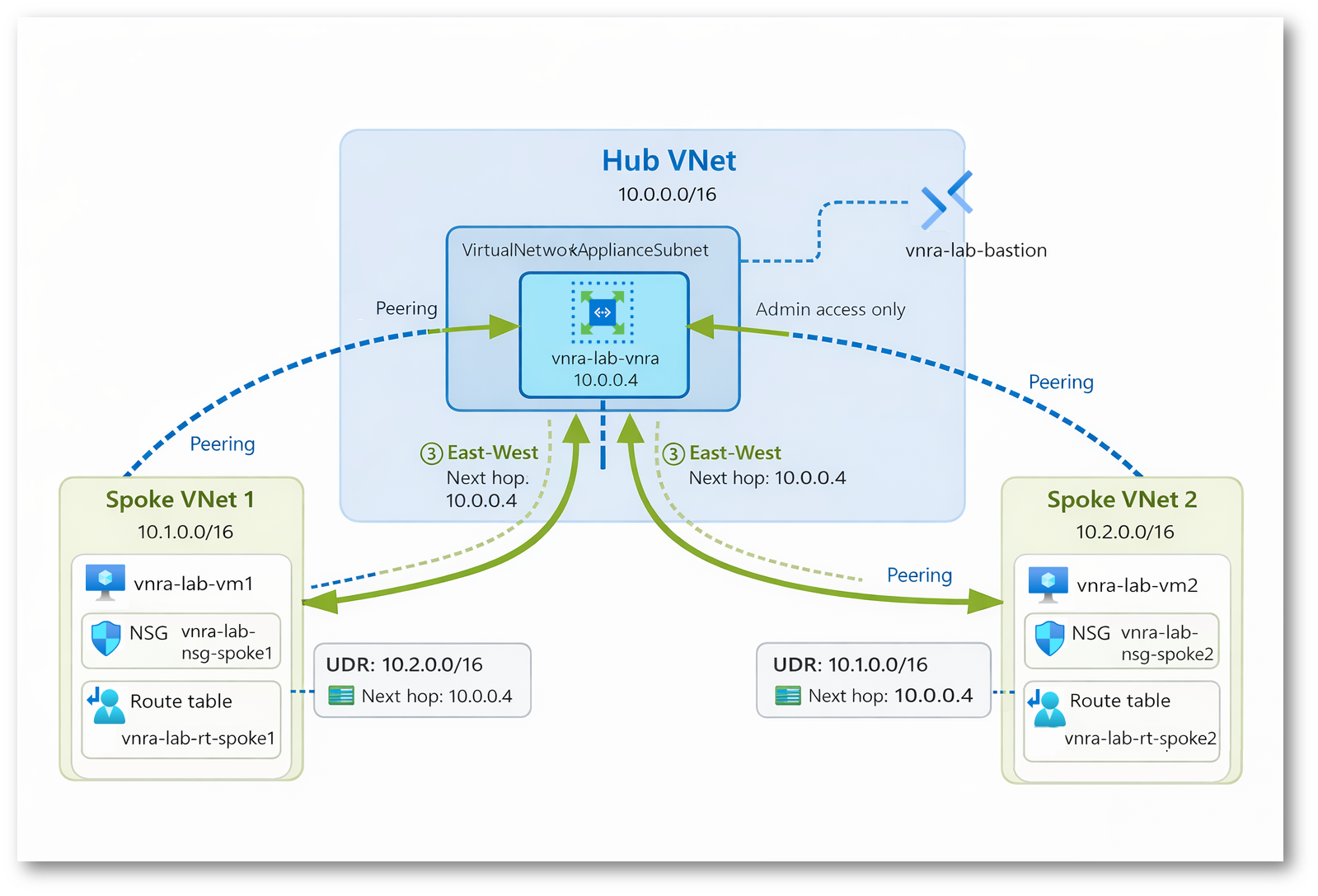

Per testare in modo concreto la Azure Virtual Network Routing Appliance ho deciso di costruire un piccolo ambiente di laboratorio completamente automatizzato tramite un file Bicep.

L’idea è realizzare un’infrastruttura semplice ma significativa, che mi permetta di osservare il comportamento del routing. Voglio creare una Virtual Network con più subnet: una dedicata esclusivamente alla VirtualNetworkApplianceSubnet, dove verrà distribuita l’appliance, e una o più subnet destinate ai workload di test.

All’interno di questo ambiente l’obiettivo è forzare il traffico tra le subnet verso la Routing Appliance, utilizzando User Defined Routes (UDR). In questo modo posso verificare che il traffico non segua il routing predefinito di Azure, ma venga effettivamente instradato attraverso il livello di forwarding gestito fornito dalla nuova funzionalità.

In pratica sto costruendo un mini–scenario Hub & Spoke semplificato, dove la VNet rappresenta il dominio di rete principale, l’appliance funge da punto centrale di instradamento e le subnet di test generano traffico da analizzare.

Automatizzare tutto con Bicep mi permette di rendere l’ambiente ripetibile, coerente e facilmente distruttibile/ricreabile, elemento fondamentale quando si lavora con funzionalità in preview che potrebbero evolvere nel tempo.

Figura 6: Scenario di laboratorio: traffico spoke↔spoke forzato verso la VNRA

Vi riporto qui di seguito il contenuto del file bicep che ho utilizzato:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 107 108 109 110 111 112 113 114 115 116 117 118 119 120 121 122 123 124 125 126 127 128 129 130 131 132 133 134 135 136 137 138 139 140 141 142 143 144 145 146 147 148 149 150 151 152 153 154 155 156 157 158 159 160 161 162 163 164 165 166 167 168 169 170 171 172 173 174 175 176 177 178 179 180 181 182 183 184 185 186 187 188 189 190 191 192 193 194 195 196 197 198 199 200 201 202 203 204 205 206 207 208 209 210 211 212 213 214 215 216 217 218 219 220 221 222 223 224 225 226 227 228 229 230 231 232 233 234 235 236 237 238 239 240 241 242 243 244 245 246 247 248 249 250 251 252 253 254 255 256 257 258 259 260 261 262 263 264 265 266 267 268 269 270 271 272 273 274 275 276 277 278 279 280 281 282 283 284 285 286 287 288 289 290 291 292 293 294 295 296 297 298 299 300 301 302 303 304 305 306 307 308 309 310 311 312 313 314 315 316 317 318 319 320 321 322 323 324 325 326 327 328 329 330 331 332 333 334 335 336 337 338 339 340 341 342 343 344 345 346 347 348 349 350 351 352 353 354 355 356 357 358 359 360 361 362 363 364 365 366 367 368 369 370 371 372 373 374 375 376 377 378 379 380 381 382 383 384 385 386 387 388 389 390 391 392 393 394 395 396 397 398 399 400 401 402 403 404 405 406 407 408 409 410 411 412 413 414 415 416 417 418 419 420 421 422 423 424 425 426 427 428 429 430 431 432 433 434 435 436 437 438 439 440 441 442 443 444 445 446 447 448 449 450 451 452 453 454 455 456 457 458 459 460 461 462 463 464 465 466 467 468 469 470 471 472 473 474 475 476 477 478 479 480 481 482 483 484 485 486 |

// main.bicep targetScope = 'resourceGroup' @description('Deployment region. Requested: West Europe.') param location string = 'westeurope' @description('Prefix for resource names.') param namePrefix string = 'vnra-lab' @description('Admin username for the Windows VMs.') param adminUsername string = 'azureuser' @secure() @description('Admin password for the Windows VMs (strong password).') param adminPassword string @description('Deploy Azure Bastion in the hub VNet.') param deployBastion bool = true @description('VM size. Requested: E4s (using Standard_E4s_v5).') param vmSize string = 'Standard_E4s_v5' @description('If set (e.g. 10.0.0.4), route tables will force Spoke1<->Spoke2 traffic to this next-hop IP (the VNRA private IP). Leave empty to skip UDR routes.') param vnraNextHopIp string = '' // -------------------- // Address spaces // -------------------- var hubVnetCidr = '10.0.0.0/16' var spoke1VnetCidr = '10.1.0.0/16' var spoke2VnetCidr = '10.2.0.0/16' // Hub subnets var hubApplianceSubnetName = 'VirtualNetworkApplianceSubnet' var hubApplianceSubnetCidr = '10.0.0.0/24' var hubBastionSubnetName = 'AzureBastionSubnet' var hubBastionSubnetCidr = '10.0.1.0/27' // Spoke subnets var spoke1SubnetName = 'Spoke1-Workload' var spoke1SubnetCidr = '10.1.1.0/24' var spoke2SubnetName = 'Spoke2-Workload' var spoke2SubnetCidr = '10.2.1.0/24' // -------------------- // NSGs // -------------------- resource nsgSpoke1 'Microsoft.Network/networkSecurityGroups@2025-05-01' = { name: '${namePrefix}-nsg-spoke1' location: location properties: { securityRules: [ { name: 'Allow-ICMP-From-VNet' properties: { priority: 100 direction: 'Inbound' access: 'Allow' protocol: 'Icmp' sourceAddressPrefix: 'VirtualNetwork' sourcePortRange: '*' destinationAddressPrefix: '*' destinationPortRange: '*' } } { name: 'Allow-RDP-From-VNet' properties: { priority: 110 direction: 'Inbound' access: 'Allow' protocol: 'Tcp' sourceAddressPrefix: 'VirtualNetwork' sourcePortRange: '*' destinationAddressPrefix: '*' destinationPortRange: '3389' } } ] } } resource nsgSpoke2 'Microsoft.Network/networkSecurityGroups@2025-05-01' = { name: '${namePrefix}-nsg-spoke2' location: location properties: { securityRules: [ { name: 'Allow-ICMP-From-VNet' properties: { priority: 100 direction: 'Inbound' access: 'Allow' protocol: 'Icmp' sourceAddressPrefix: 'VirtualNetwork' sourcePortRange: '*' destinationAddressPrefix: '*' destinationPortRange: '*' } } { name: 'Allow-RDP-From-VNet' properties: { priority: 110 direction: 'Inbound' access: 'Allow' protocol: 'Tcp' sourceAddressPrefix: 'VirtualNetwork' sourcePortRange: '*' destinationAddressPrefix: '*' destinationPortRange: '3389' } } ] } } // -------------------- // Route tables (Spokes) // -------------------- resource rtSpoke1 'Microsoft.Network/routeTables@2025-05-01' = { name: '${namePrefix}-rt-spoke1' location: location properties: { disableBgpRoutePropagation: false } } resource rtSpoke2 'Microsoft.Network/routeTables@2025-05-01' = { name: '${namePrefix}-rt-spoke2' location: location properties: { disableBgpRoutePropagation: false } } // Child resources using parent: resource rtSpoke1RouteToSpoke2 'Microsoft.Network/routeTables/routes@2025-05-01' = if (vnraNextHopIp != '') { parent: rtSpoke1 name: 'to-spoke2-via-vnra' properties: { addressPrefix: spoke2VnetCidr nextHopType: 'VirtualAppliance' nextHopIpAddress: vnraNextHopIp } } resource rtSpoke2RouteToSpoke1 'Microsoft.Network/routeTables/routes@2025-05-01' = if (vnraNextHopIp != '') { parent: rtSpoke2 name: 'to-spoke1-via-vnra' properties: { addressPrefix: spoke1VnetCidr nextHopType: 'VirtualAppliance' nextHopIpAddress: vnraNextHopIp } } // -------------------- // VNets // -------------------- resource vnetHub 'Microsoft.Network/virtualNetworks@2023-11-01' = { name: '${namePrefix}-vnet-hub' location: location properties: { addressSpace: { addressPrefixes: [ hubVnetCidr ] } subnets: [ { name: hubApplianceSubnetName properties: { addressPrefix: hubApplianceSubnetCidr } } { name: hubBastionSubnetName properties: { addressPrefix: hubBastionSubnetCidr } } ] } } resource vnetSpoke1 'Microsoft.Network/virtualNetworks@2023-11-01' = { name: '${namePrefix}-vnet-spoke1' location: location properties: { addressSpace: { addressPrefixes: [ spoke1VnetCidr ] } subnets: [ { name: spoke1SubnetName properties: { addressPrefix: spoke1SubnetCidr networkSecurityGroup: { id: nsgSpoke1.id } routeTable: { id: rtSpoke1.id } } } ] } } resource vnetSpoke2 'Microsoft.Network/virtualNetworks@2023-11-01' = { name: '${namePrefix}-vnet-spoke2' location: location properties: { addressSpace: { addressPrefixes: [ spoke2VnetCidr ] } subnets: [ { name: spoke2SubnetName properties: { addressPrefix: spoke2SubnetCidr networkSecurityGroup: { id: nsgSpoke2.id } routeTable: { id: rtSpoke2.id } } } ] } } // -------------------- // VNRA // -------------------- resource vnra 'Microsoft.Network/virtualNetworkAppliances@2025-05-01' = { name: '${namePrefix}-vnra' location: location properties: { bandwidthInGbps: '50' subnet: { id: resourceId('Microsoft.Network/virtualNetworks/subnets', vnetHub.name, hubApplianceSubnetName) } } } // -------------------- // Peerings using parent: // -------------------- resource peerHubToSpoke1 'Microsoft.Network/virtualNetworks/virtualNetworkPeerings@2023-11-01' = { parent: vnetHub name: 'to-${vnetSpoke1.name}' properties: { remoteVirtualNetwork: { id: vnetSpoke1.id } allowVirtualNetworkAccess: true allowForwardedTraffic: true allowGatewayTransit: false useRemoteGateways: false } } resource peerSpoke1ToHub 'Microsoft.Network/virtualNetworks/virtualNetworkPeerings@2023-11-01' = { parent: vnetSpoke1 name: 'to-${vnetHub.name}' properties: { remoteVirtualNetwork: { id: vnetHub.id } allowVirtualNetworkAccess: true allowForwardedTraffic: true allowGatewayTransit: false useRemoteGateways: false } } resource peerHubToSpoke2 'Microsoft.Network/virtualNetworks/virtualNetworkPeerings@2023-11-01' = { parent: vnetHub name: 'to-${vnetSpoke2.name}' properties: { remoteVirtualNetwork: { id: vnetSpoke2.id } allowVirtualNetworkAccess: true allowForwardedTraffic: true allowGatewayTransit: false useRemoteGateways: false } } resource peerSpoke2ToHub 'Microsoft.Network/virtualNetworks/virtualNetworkPeerings@2023-11-01' = { parent: vnetSpoke2 name: 'to-${vnetHub.name}' properties: { remoteVirtualNetwork: { id: vnetHub.id } allowVirtualNetworkAccess: true allowForwardedTraffic: true allowGatewayTransit: false useRemoteGateways: false } } // -------------------- // Azure Bastion (Hub) // -------------------- resource bastionPip 'Microsoft.Network/publicIPAddresses@2025-05-01' = if (deployBastion) { name: '${namePrefix}-pip-bastion' location: location sku: { name: 'Standard' } properties: { publicIPAllocationMethod: 'Static' } } resource bastion 'Microsoft.Network/bastionHosts@2025-05-01' = if (deployBastion) { name: '${namePrefix}-bastion' location: location sku: { name: 'Standard' } properties: { ipConfigurations: [ { name: 'bastion-ipconfig' properties: { subnet: { id: resourceId('Microsoft.Network/virtualNetworks/subnets', vnetHub.name, hubBastionSubnetName) } publicIPAddress: { id: bastionPip.id } } } ] } } // -------------------- // NICs + Windows VMs (no Public IPs) // -------------------- resource nicVm1 'Microsoft.Network/networkInterfaces@2025-05-01' = { name: '${namePrefix}-nic-vm1' location: location properties: { ipConfigurations: [ { name: 'ipconfig1' properties: { privateIPAllocationMethod: 'Dynamic' subnet: { id: resourceId('Microsoft.Network/virtualNetworks/subnets', vnetSpoke1.name, spoke1SubnetName) } } } ] } } resource nicVm2 'Microsoft.Network/networkInterfaces@2025-05-01' = { name: '${namePrefix}-nic-vm2' location: location properties: { ipConfigurations: [ { name: 'ipconfig1' properties: { privateIPAllocationMethod: 'Dynamic' subnet: { id: resourceId('Microsoft.Network/virtualNetworks/subnets', vnetSpoke2.name, spoke2SubnetName) } } } ] } } resource vm1 'Microsoft.Compute/virtualMachines@2024-07-01' = { name: '${namePrefix}-vm1' location: location properties: { hardwareProfile: { vmSize: vmSize } osProfile: { computerName: 'vm1' adminUsername: adminUsername adminPassword: adminPassword windowsConfiguration: { provisionVMAgent: true enableAutomaticUpdates: true } } storageProfile: { imageReference: { publisher: 'MicrosoftWindowsServer' offer: 'WindowsServer' sku: '2022-datacenter-g2' version: 'latest' } osDisk: { createOption: 'FromImage' managedDisk: { storageAccountType: 'StandardSSD_LRS' } } } networkProfile: { networkInterfaces: [ { id: nicVm1.id } ] } } } resource vm2 'Microsoft.Compute/virtualMachines@2024-07-01' = { name: '${namePrefix}-vm2' location: location properties: { hardwareProfile: { vmSize: vmSize } osProfile: { computerName: 'vm2' adminUsername: adminUsername adminPassword: adminPassword windowsConfiguration: { provisionVMAgent: true enableAutomaticUpdates: true } } storageProfile: { imageReference: { publisher: 'MicrosoftWindowsServer' offer: 'WindowsServer' sku: '2022-datacenter-g2' version: 'latest' } osDisk: { createOption: 'FromImage' managedDisk: { storageAccountType: 'StandardSSD_LRS' } } } networkProfile: { networkInterfaces: [ { id: nicVm2.id } ] } } } // -------------------- // Outputs // -------------------- output hubVnetName string = vnetHub.name output spoke1VnetName string = vnetSpoke1.name output spoke2VnetName string = vnetSpoke2.name output vnraResourceId string = vnra.id output vnraSubnetId string = resourceId('Microsoft.Network/virtualNetworks/subnets', vnetHub.name, hubApplianceSubnetName) // Avoid BCP318: output the Public IP resource ID (safe), not properties.ipAddress. output bastionName string = deployBastion ? bastion.name : '' output bastionPublicIpResourceId string = deployBastion ? bastionPip.id : '' output vm1PrivateIp string = nicVm1.properties.ipConfigurations[0].properties.privateIPAddress output vm2PrivateIp string = nicVm2.properties.ipConfigurations[0].properties.privateIPAddress |

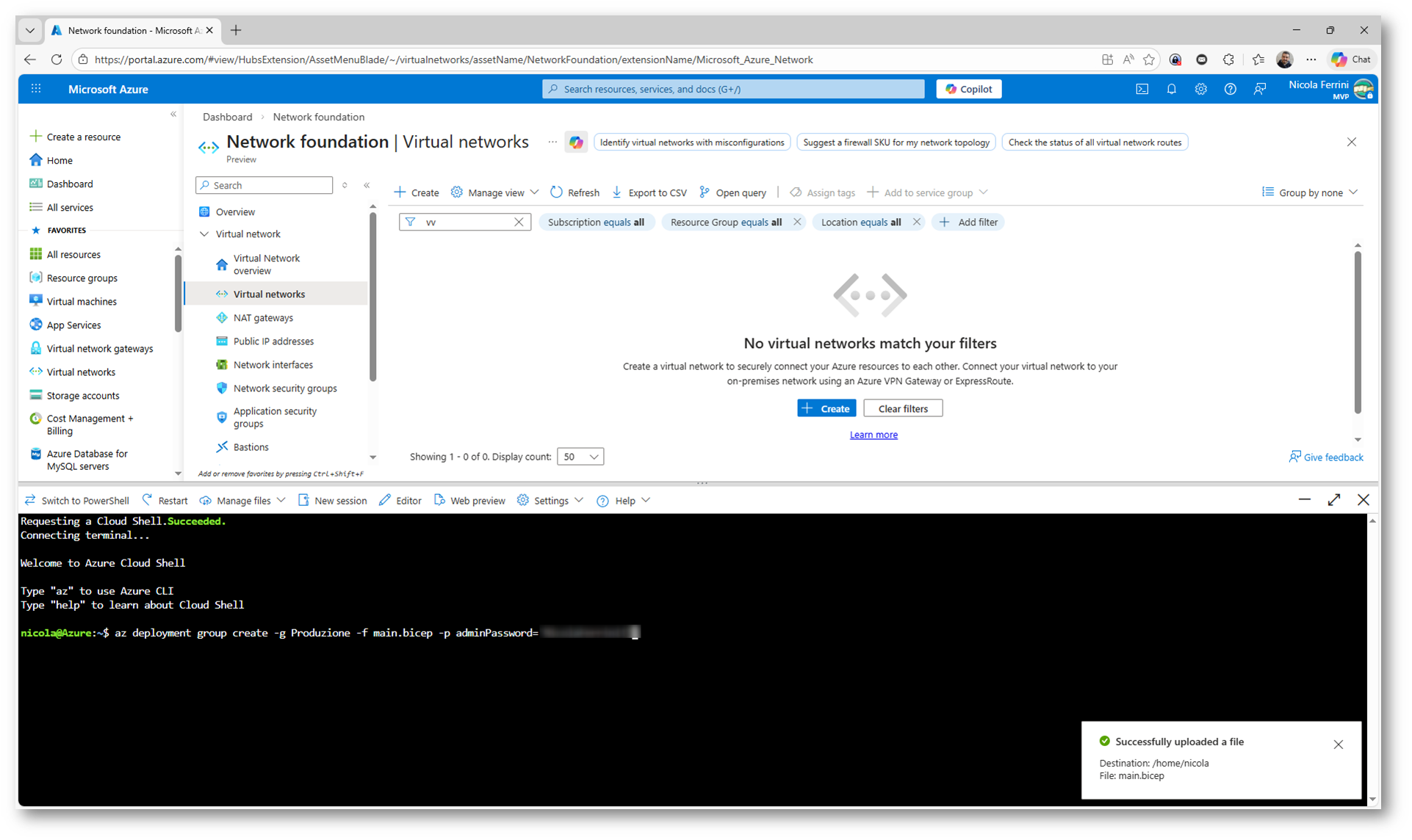

Deploy del laboratorio tramite Azure Cloud Shell

Per distribuire rapidamente l’ambiente di test utilizziamo la Azure Cloud Shell e il primo passo consiste nel caricare il file Bicep (nel mio caso l’ho chiamato main.bicep) all’interno dello storage account associato alla Cloud Shell. È possibile farlo tramite l’opzione di upload oppure copiandolo nel file share associato allo storage della shell.

Successivamente va creato un Resource Group in una delle region attualmente supportate dalla preview della Virtual Network Routing Appliance. Come indicato nella documentazione ufficiale Microsoft, la disponibilità è limitata a specifiche regioni. Nel mio caso ho scelto West Europe e ho chiamato il Resource Group Produzione.

La creazione del Resource Group può essere eseguita con:

|

1 2 |

az group create --name <RG> --location westeurope |

Una volta creato il Resource Group, possiamo avviare il deployment dell’infrastruttura definita nel file Bicep con il comando:

|

1 2 |

az deployment group create -g <RG> -f main.bicep -p adminPassword='<PASSWORD_FORTE>' |

Con questo comando viene avviato un deployment a livello di Resource Group, utilizzando il template dichiarativo contenuto in main.bicep. Il parametro adminPassword consente di valorizzare la password amministrativa richiesta per le macchine virtuali di test presenti nel laboratorio.

Figura 7: Esecuzione del comando az deployment group create dalla Azure Cloud Shell per distribuire il laboratorio tramite file Bicep

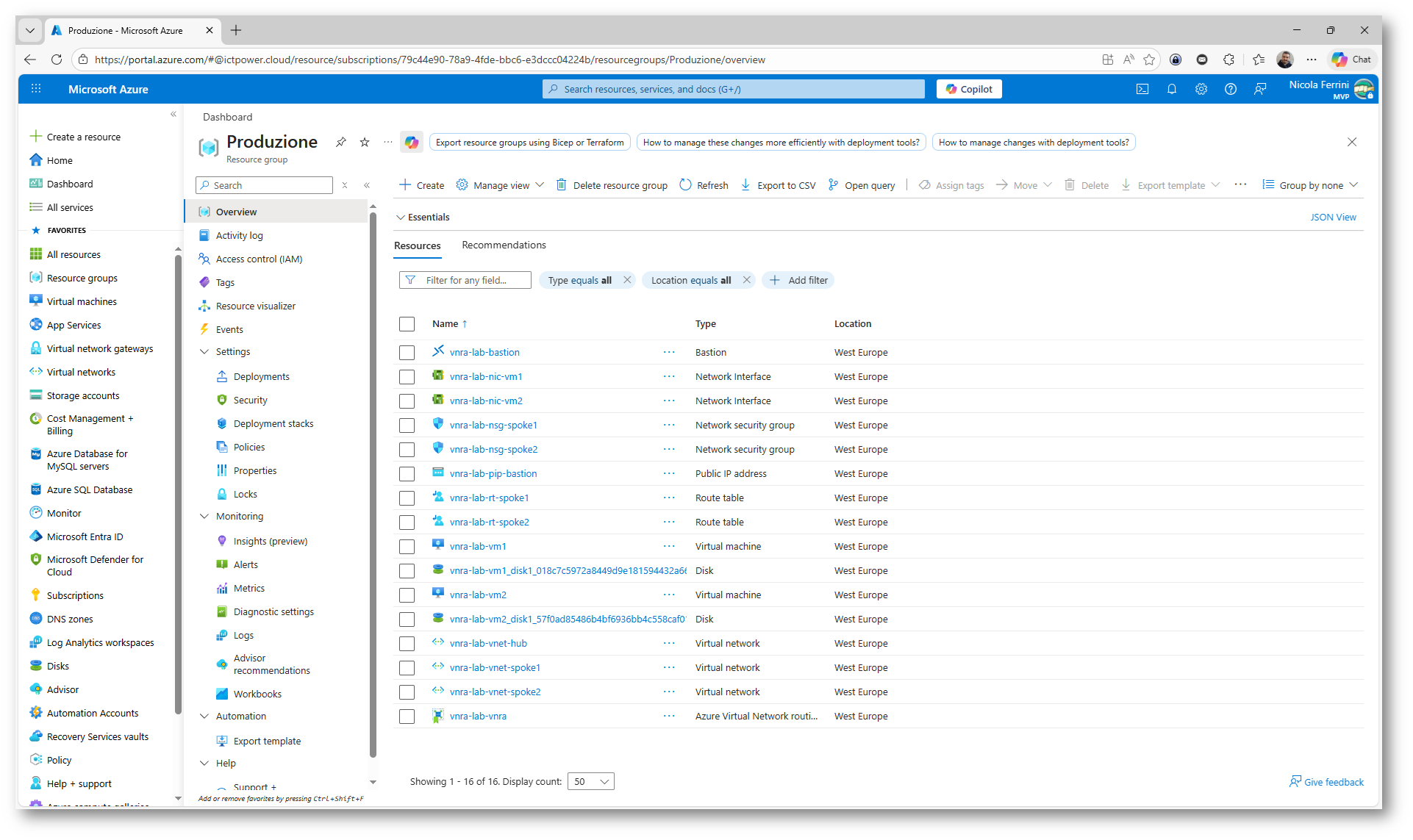

Al termine del deployment, all’interno del Resource Group Produzione vengono create automaticamente tutte le risorse definite nel file Bicep.

Come si può vedere dalla figura sotto, l’infrastruttura comprende diversi componenti che costituiscono il laboratorio di test per la Azure Virtual Network Routing Appliance.

Sono presenti le Virtual Network (hub e spoke), le relative Network Interface, le Virtual Machine di test, le route table associate alle subnet, i Network Security Group, un Bastion Host per l’accesso sicuro alle VM e, naturalmente, la risorsa Azure Virtual Network routing appliance.

Figura 8: Risorse create automaticamente nel Resource Group Produzione al termine del deployment del file Bicep

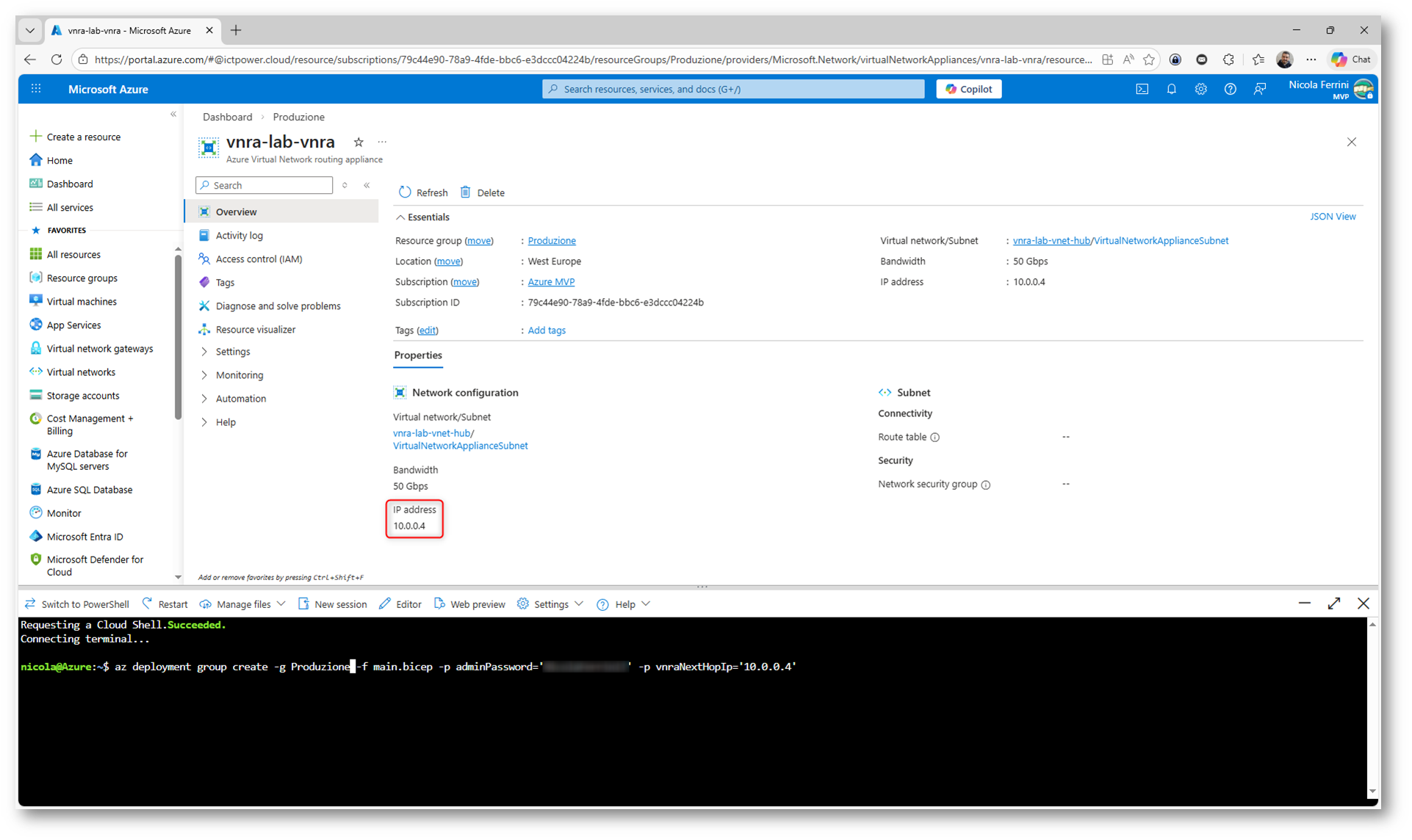

Dopo il primo deployment, la Virtual Network Routing Appliance viene creata correttamente, ma c’è un passaggio chiave per completare lo scenario di laboratorio: recuperare il suo IP privato e usarlo come next hop nelle UDR delle spoke.

Aprendo la risorsa vnra-lab-vnra nel portale Azure, nella sezione Overview si trova l’informazione che ci serve: l’IP address assegnato all’appliance (nell’esempio evidenziato è 10.0.0.4). Questo valore è fondamentale perché nelle route table delle spoke vogliamo forzare il traffico spoke-spoke passando dalla VNRA, e per farlo dobbiamo indicare esplicitamente il next hop.

A questo punto si ridistribuisce lo stesso file

Bicep, passando un parametro aggiuntivo (ad esempio vnraNextHopIp) valorizzato con l’IP privato appena recuperato. In pratica, il secondo deploy non ricrea tutto da zero, ma aggiorna la configurazione applicando le route table con il next hop corretto.

Il comando diventa:

|

1 2 |

az deployment group create -g <RG> -f main.bicep -p adminPassword='<PASSWORD_FORTE>' -p vnraNextHopIp='10.0.0.X' |

Nel mio caso, avendo rilevato 10.0.0.4, il parametro viene impostato di conseguenza. Da questo momento le UDR nelle spoke risultano attive e il traffico tra le due reti spoke viene instradato verso la Routing Appliance come livello di forwarding centralizzato.

Figura 10: Recupero dell’IP privato della Virtual Network Routing Appliance e ridistribuzione del template Bicep per configurare le UDR spoke-spoke con il next hop corretto

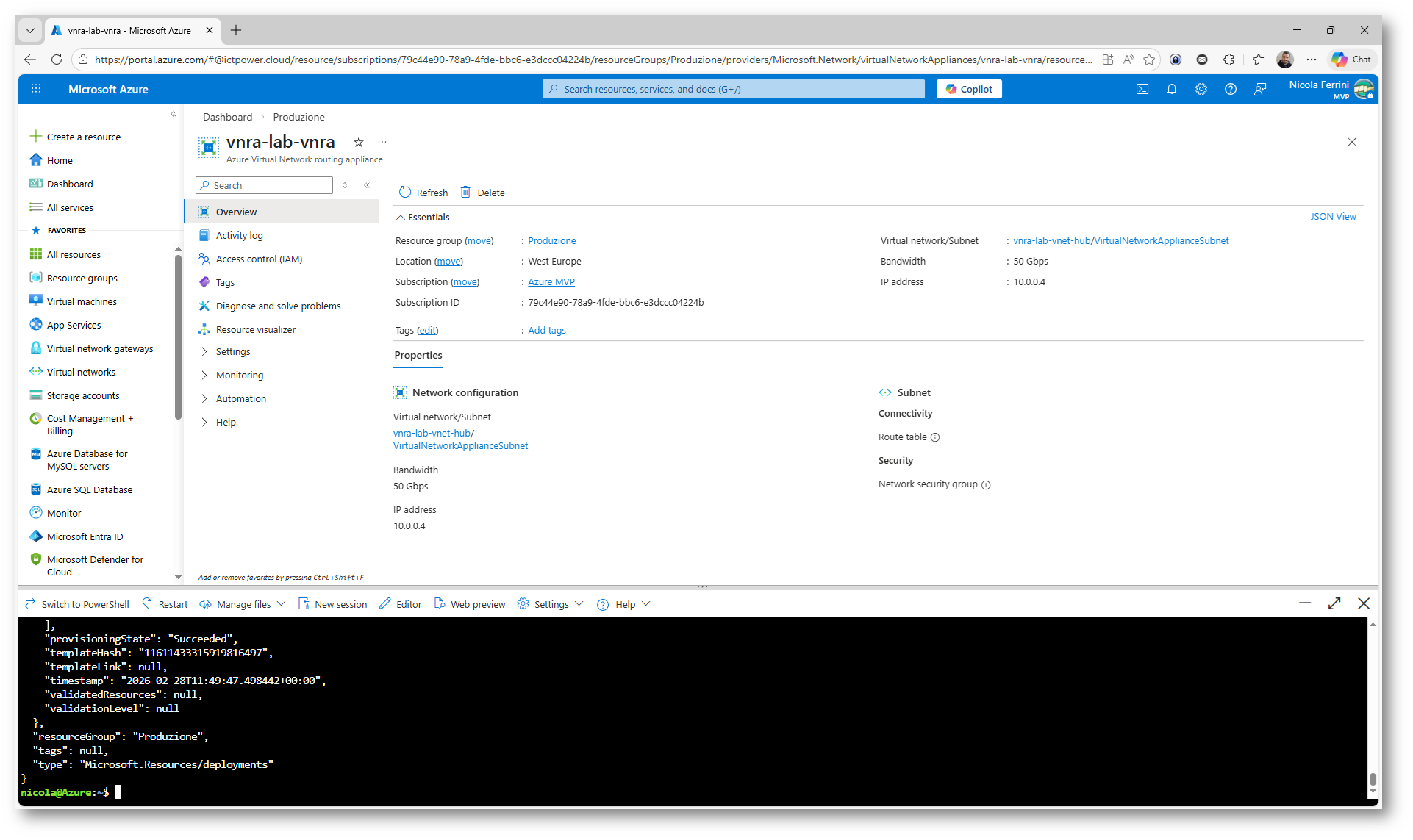

Il secondo deployment è terminato correttamente, come si può vedere dal messaggio “provisioningState”: “Succeeded” nella Cloud Shell nella figura sotto.

Questo significa che il template Bicep è stato rieseguito con il parametro vnraNextHopIp valorizzato con l’IP privato della Virtual Network Routing Appliance (nel mio caso 10.0.0.4) e che le User Defined Routes sono state aggiornate correttamente.

A questo punto lo scenario è completo:

- la VNRA è operativa nella subnet dedicata

- le route table delle spoke puntano all’IP della appliance come next hop

- il traffico spoke-spoke non segue più il routing predefinito di Azure

- il forwarding viene gestito dalla Routing Appliance

Dal punto di vista architetturale, ora il traffico tra le due spoke attraversa esplicitamente il layer di forwarding gestito fornito dalla nuova funzionalità in preview, permettendo di validarne il comportamento reale.

Il prossimo passo, se vogliamo completare il test, è verificare le Effective Routes sulle NIC delle VM oppure effettuare test di connettività (ad esempio con ping o Test-NetConnection) per confermare che il percorso venga effettivamente instradato tramite la VNRA.

Figura 11: Deployment completato con stato Succeeded dopo l’aggiornamento delle UDR con l’IP privato della Virtual Network Routing Appliance

Test di funzionamento

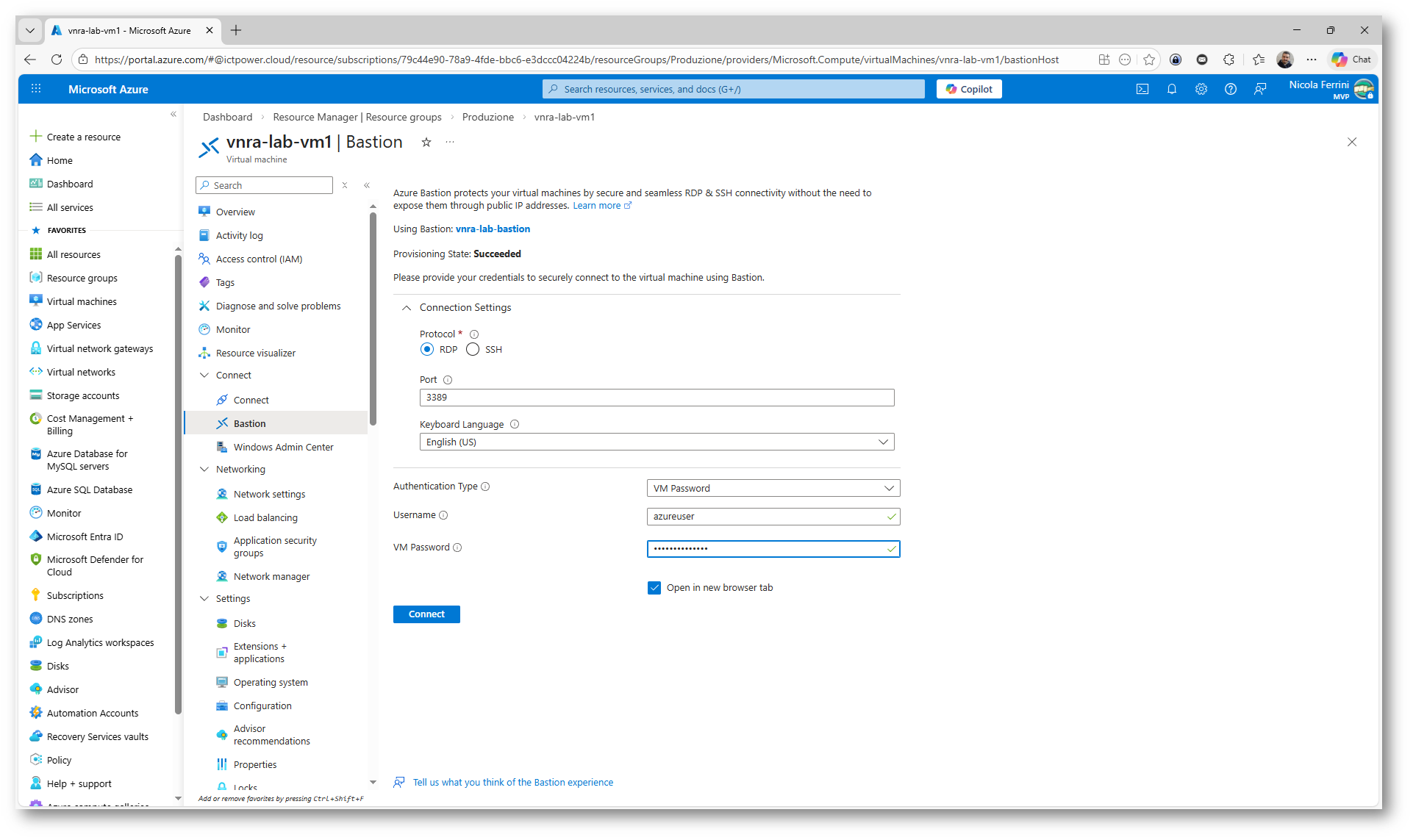

A questo punto inizio la fase di validazione dell’architettura.

Mi collego alla macchina virtuale vnra-lab-vm1 utilizzando Azure Bastion, evitando così l’esposizione di Public IP sulle VM di test. Dalla sezione Bastion della VM seleziono il protocollo RDP, inserisco le credenziali locali definite nel template Bicep e avvio la connessione direttamente dal browser.

Una volta stabilita la sessione su VM1, l’obiettivo è verificare la connettività verso VM2, che si trova nella seconda spoke. In questo scenario, grazie alle User Defined Routes aggiornate con l’IP privato della Virtual Network Routing Appliance, il traffico non deve seguire il routing predefinito di Azure ma deve essere instradato verso la VNRA come next hop.

Figura 12: Connessione alla VM1 tramite Azure Bastion per avviare i test di connettività verso la VM2 nella seconda spoke

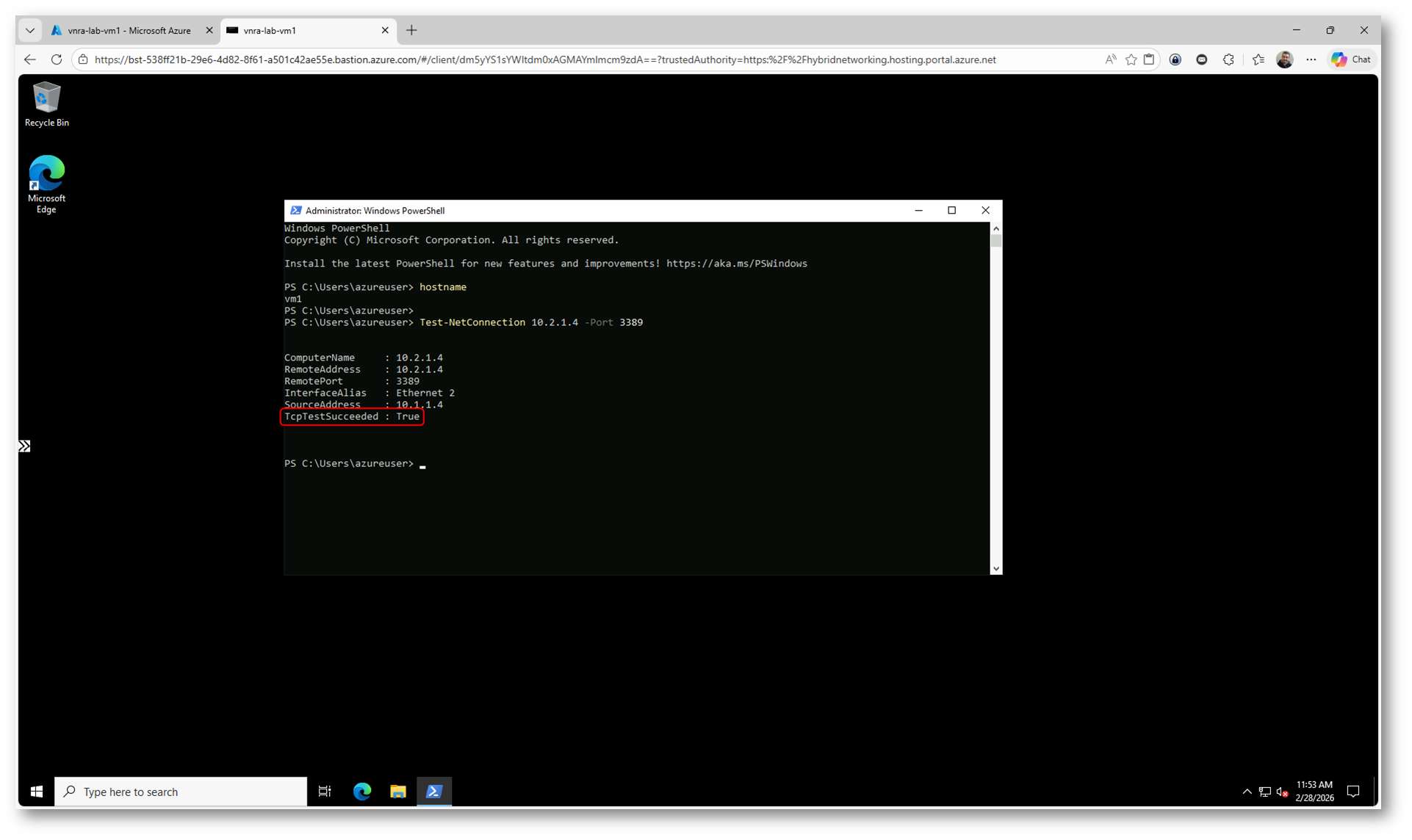

Una volta connesso alla VM1 tramite Azure Bastion, procedo con il test di connettività verso la VM2.

Per prima cosa verifico l’IP privato della VM2 (nel mio laboratorio è 10.2.1.4). Questo è l’indirizzo che deve essere raggiunto passando attraverso la Virtual Network Routing Appliance, grazie alle UDR configurate con il next hop impostato sull’IP della VNRA.

Dalla sessione PowerShell su VM1 eseguo il comando:

|

1 2 |

Test-NetConnection 10.2.1.4 -Port 3389 |

Il test verifica la raggiungibilità della porta 3389 (RDP) sull’host remoto.

Nel risultato, il parametro chiave è TcpTestSucceeded : True. Questo valore conferma che la connessione TCP è stata stabilita correttamente e che la comunicazione tra le due spoke è funzionante.

Figura 13: Test di connettività da VM1 verso VM2 con Test-NetConnection sulla porta 3389

Oltre al test applicativo con Test-NetConnection, il metodo più preciso per verificare che il traffico stia realmente attraversando la Virtual Network Routing Appliance è controllare il Next Hop.

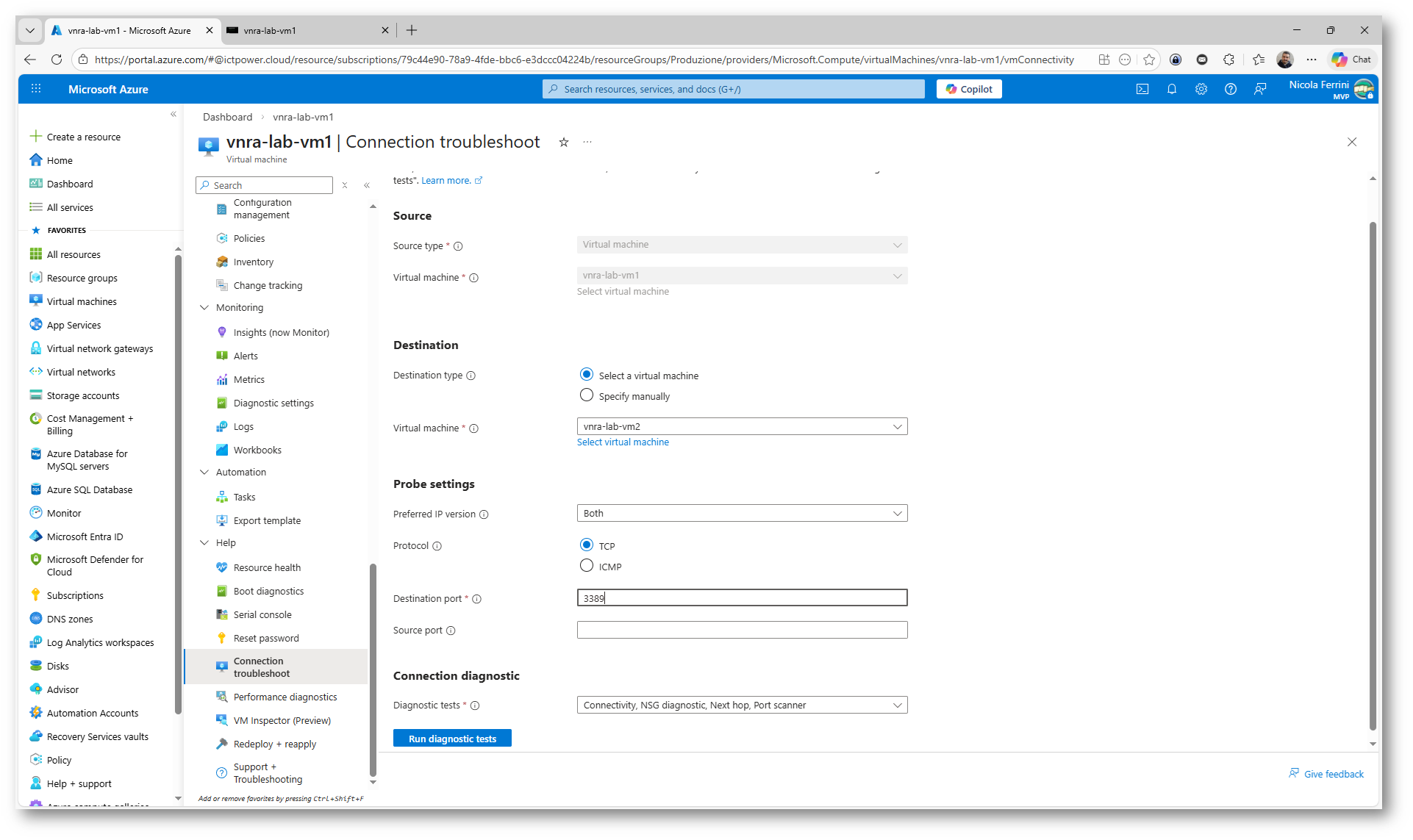

Dal portale Azure, sulla VM vnra-lab-vm1, accedo alla sezione Connection troubleshoot (Network Watcher). Imposto come:

- Source: vnra-lab-vm1

- Destination: vnra-lab-vm2

- Protocol: TCP

- Port: 3389

e avvio i diagnostic tests.

Tra i risultati forniti dal tool è presente l’informazione sul Next hop, che indica quale percorso viene utilizzato per raggiungere la destinazione. Se la configurazione delle UDR è corretta, il Next Hop non deve essere “VNet peering” o “Internet”, ma deve puntare all’IP privato della VNRA (nel mio caso 10.0.0.4).

Figura 14: Verifica del Next Hop tramite Connection troubleshoot per confermare che il traffico verso VM2 passi attraverso la Virtual Network Routing Appliance

Questo controllo è più affidabile rispetto a un semplice ping o test TCP, perché conferma esplicitamente la rotta utilizzata, verifica l’applicazione delle User Defined Routes e permette di escludere fallback automatici del routing di Azure.

Se il Next Hop restituito corrisponde all’IP della Routing Appliance, significa che il traffico spoke-spoke viene effettivamente instradato attraverso il layer di forwarding gestito della VNRA.

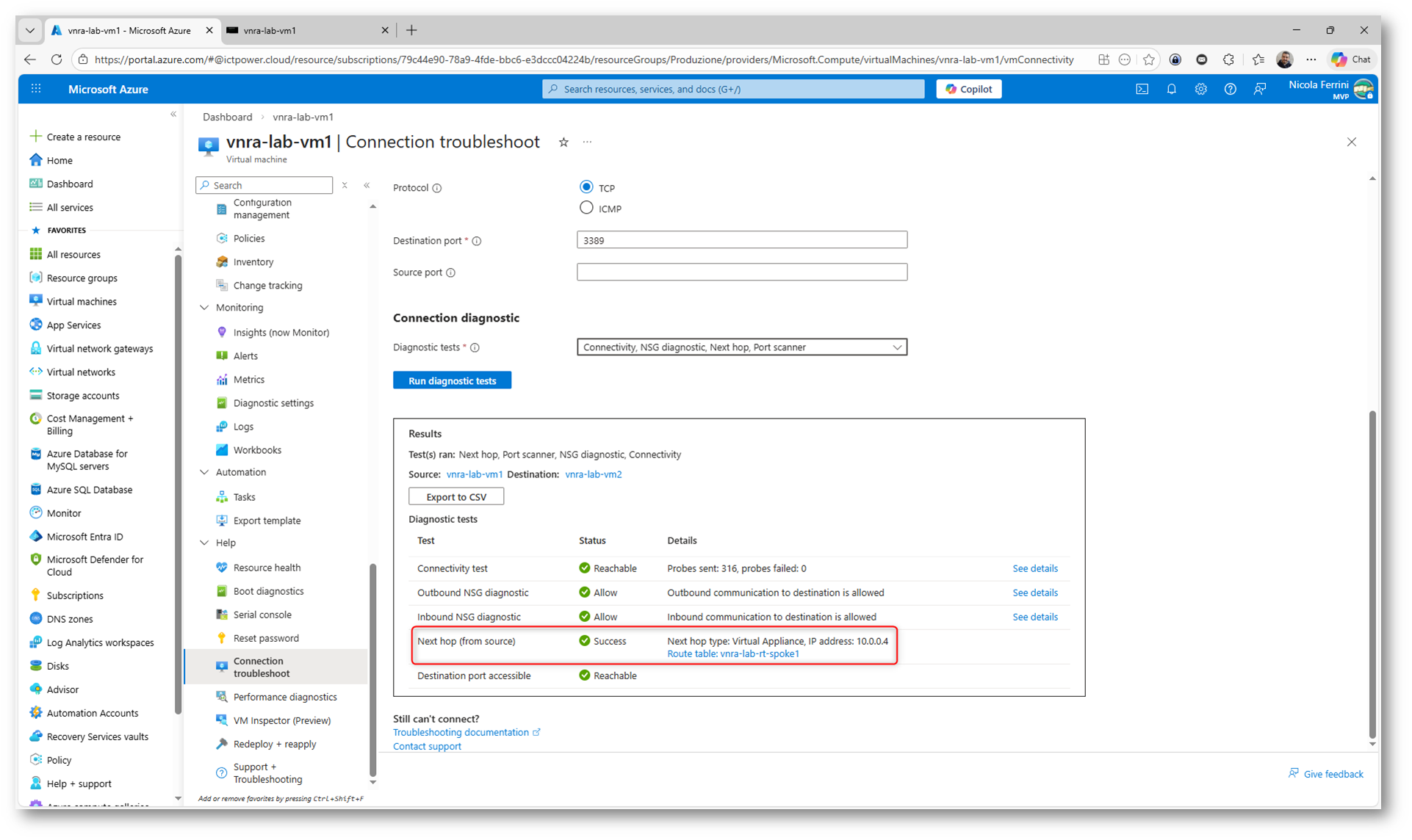

Come si può vedere dalla figura sotto, Il test di Connection troubleshoot conferma in modo inequivocabile che il traffico sta attraversando la Virtual Network Routing Appliance.

Nel risultato del diagnostico, alla voce Next hop (from source), si vede chiaramente:

- Next hop type: Virtual Appliance

- IP address: 10.0.0.4

- Route table: vnra-lab-rt-spoke1

Questo è il punto chiave. Non stiamo semplicemente verificando che la VM2 sia raggiungibile, ma che la rotta effettivamente utilizzata sia quella definita nelle User Defined Routes.

Figura 15: Verifica del Next Hop: il traffico verso VM2 utilizza una Virtual Appliance con IP 10.0.0.4, confermando il passaggio attraverso la VNRA

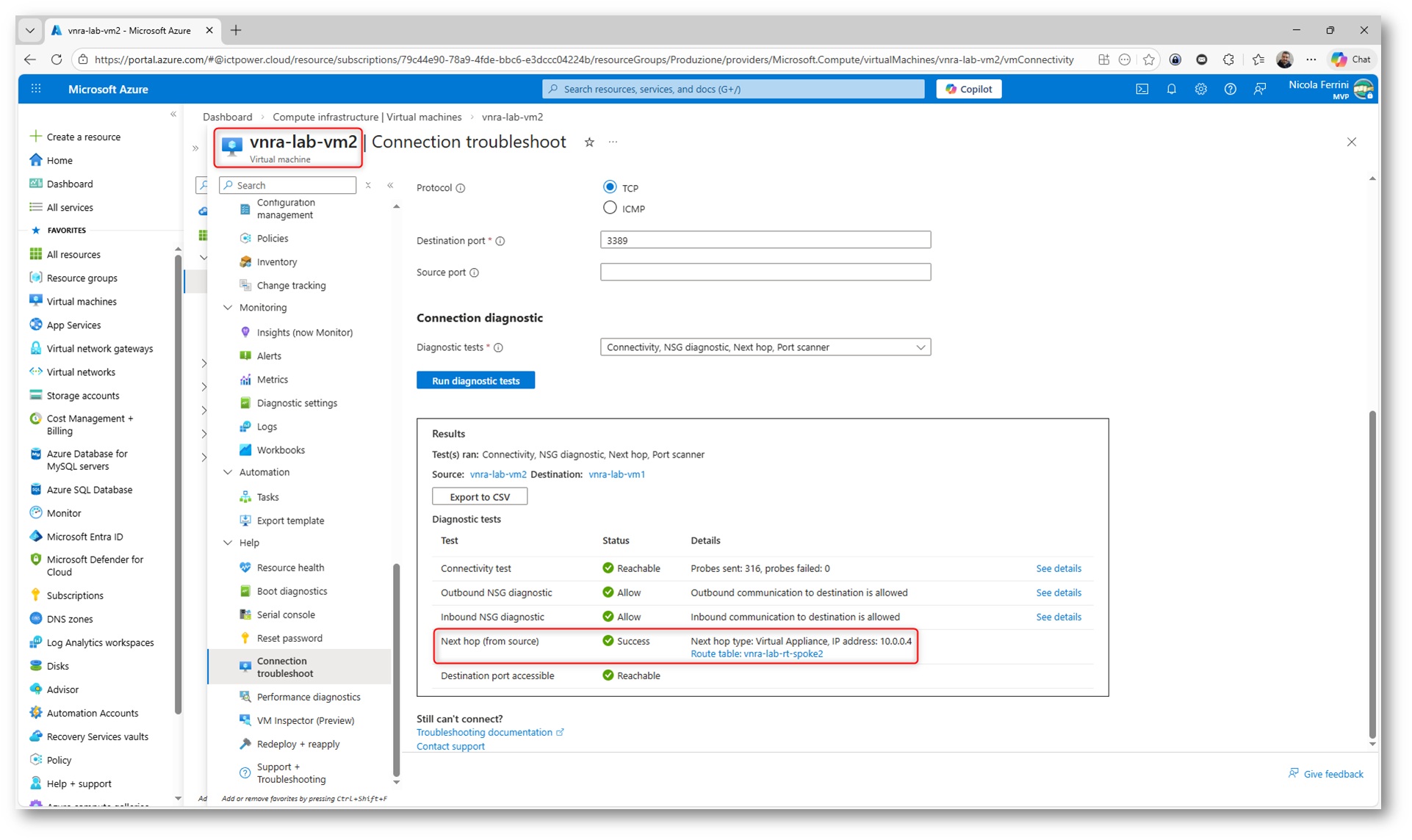

Per essere ancora più rigorosi, possiamo verificare anche il routing simmetrico, controllando il percorso nel senso opposto.

Mi sposto quindi sulla VM vnra-lab-vm2 e utilizzo nuovamente la funzionalità Connection troubleshoot verso vnra-lab-vm1, sempre sulla porta 3389.

Il risultato è coerente con quanto visto in precedenza:

- Next hop type: Virtual Appliance

- IP address: 10.0.0.4

- Route table: vnra-lab-rt-spoke2

Questo è un passaggio importante dal punto di vista architetturale. Non basta che il traffico VM1 → VM2 passi dalla VNRA: anche il traffico di ritorno VM2 → VM1 deve seguire lo stesso percorso. In caso contrario si avrebbe un routing asimmetrico, che potrebbe causare problemi in scenari più complessi (ad esempio con firewall stateful o inspection del traffico).

Figura 16: Verifica del routing simmetrico: anche il traffico da VM2 verso VM1 utilizza come next hop la Virtual Appliance con IP 10.0.0.4

Conclusioni

La Azure Virtual Network Routing Appliance, attualmente in preview, introduce un approccio completamente gestito al forwarding del traffico all’interno delle Virtual Network.

Nel laboratorio abbiamo costruito uno scenario Hub & Spoke realistico, automatizzato tramite Bicep, e verificato in modo oggettivo che il traffico spoke↔spoke venga effettivamente instradato verso la Virtual Appliance configurata come next hop nelle UDR.

L’aspetto più interessante è che il livello di forwarding non è più basato su macchine virtuali gestite manualmente, ma su una risorsa Azure-native, con alta disponibilità integrata e throughput configurabile.

Essendo una funzionalità in preview, va valutata con attenzione in ambienti di produzione. Tuttavia, dal punto di vista architetturale, rappresenta un’evoluzione significativa nel modo in cui possiamo progettare il routing centralizzato su Azure, riducendo complessità operativa e potenziali colli di bottiglia.